---- 本周为您解读 ④ 个值得细品的 AI & Robotics 业内要事 ----

1. 最强大的语言模型仍会变化?

最强大的语言模型仍会变化?一项对当前模型无用的技术也许三五年后就能变得有用?ChatGPT 成功的关键是什么?现阶段关于 LLM 的主流思想与判断在未来几年是否仍有参考价值?LLM 的未来趋势都有哪些?...

2. LLM 能如何缓解具身智能数据匮乏问题?

MIT CSAIL 的任务模拟器了解一下?模拟的任务数据更好用吗?模拟任务数据训练的机器人表现更好了吗?具身智能方向还有哪些数据工作?...

3. 大模型公司今年赚了多少钱?

OpenAI 营收暴涨靠什么?哪些业务带来了主要营收?同样做大模型业务,微软被曝亏损是什么情况?做大模型业务靠什么赚钱?国内外其他公司做大模型业务都赚钱了吗?...

4. 代码模型的是与非

LLM 取代程序员还远吗?LLM 能解决真实的编程问题吗?专门的代码模型表现如何?代码模型还有哪些价值?...

...本期完整版通讯含以上 4 项专题解读 + 31 项本周 AI & Robotics 赛道要事速递,其中技术方面 17 项,国内方面 8 项,国外方面 6 项...

本期通讯总计 23576 字,可免费试读至 6 % 消耗 99 微信豆即可兑换完整本期解读(约合人民币 9.9 元) 要事解读 ① 最强大的语言模型仍会变化?

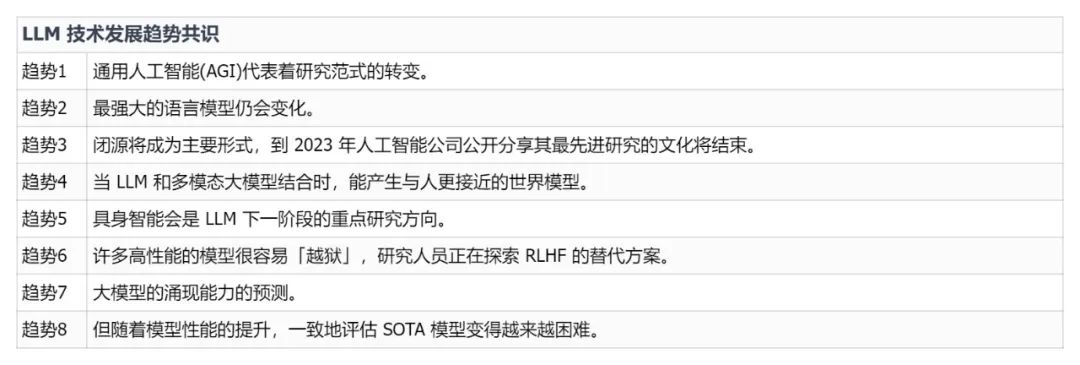

事件:OpenAI 科学家 Hyung Won Chung 认为,最强大的语言模型仍会变化,一项对当前模型无用的技术也许三五年后就能变得有用。1、近期,OpenAI 研究科学家 Hyung Won Chung 发表了 LLM 相关演讲;2023 年度《人工智能全景报告》(State of AI Report)发布;以及部分 AI 业内从业者、学者也相继发表了对于大语言模型的阶段性思考与未来趋势研判。2、OpenAI 研究科学家 Hyung Won Chung 认为,现在所谓的大型语言模型(LLM)在几年后就会被认为是小模型。随着人们对模型规模(scale)的认知的变化,目前有关 LLM 的许多见解、观察和结论都会变得过时甚至可能被证明是错误的。3、Chung 认为,可以把一定时段内最强大的模型视为「公理」,因为在这段时间里,很多研究实验都是基于该模型进行的。但有趣的地方在于:最强大的模型会变化。4、《人工智能全景报告》中提到,OpenAI 的 GPT-4 在发布八个月后仍然是最强的大语言模型(LLM),「在经典基准测试和旨在评估人类的考试上都击败了所有其他大模型。」但随着尖端人工智能系统变得更加强大和灵活,比较它们会变得越来越困难。我们基于以上资料并结合其他公开资料对于 LLM 未来趋势的相关观点进行了盘查,总结了几大业内较为共识的 LLM 未来趋势。

业界大佬们对 LLM 未来发展趋势有哪些不同意见?① 目前,业内普遍研究者认为,以 GPT-4 为代表的大模型已经在足够的语料上进行了训练,在此基础上构建的代理有潜力成为打开 AGI 之门的钥匙。② 其他研究者认为,自回归语言建模(Auto-regressive Language Modeling)并不能显现出真正的智能,因为它们只是作出响应。一个更完备的建模方式,例如世界模型(World Model),才能通向 AGI。③ 图灵奖得主 Yann LeCun 认为,「从现在起 5 年内,没有哪个头脑正常的人会使用自回归模型。」当前大部分基于机器学习的 AI 系统都会犯非常愚蠢的错误,不会推理(reason),也不会规划(plan)。LeCun 提出了构建「世界」模型的想法,构建一个能够进行推理和规划的认知架构。未来几十年阻碍人工智能发展的真正障碍是为世界模型设计架构以及训练范式。④ 「强化学习之父」萨顿(Richard Sutton)认为,基础智能代理模型将是「智能代理的共同模型」,作为 AI、心理学、控制理论、神经科学和经济学的共同基础。强调普通经验,而不是特殊的训练集、人工协助或访问世界的内部结构。强调时间一致性,与代理上运行的算法相比,所有时间都是相同的,没有特殊的训练。① OpenAI 科学家 Hyung Won Chung 认为,可以把一定时段内最强大的模型视为「公理」,因为在这段时间里,很多研究实验都是基于该模型进行的,但有趣的地方在于:最强大的模型会变化。