特斯拉自动驾驶出事了,就在加州(图)

huangs

楼主 (北美华人网)

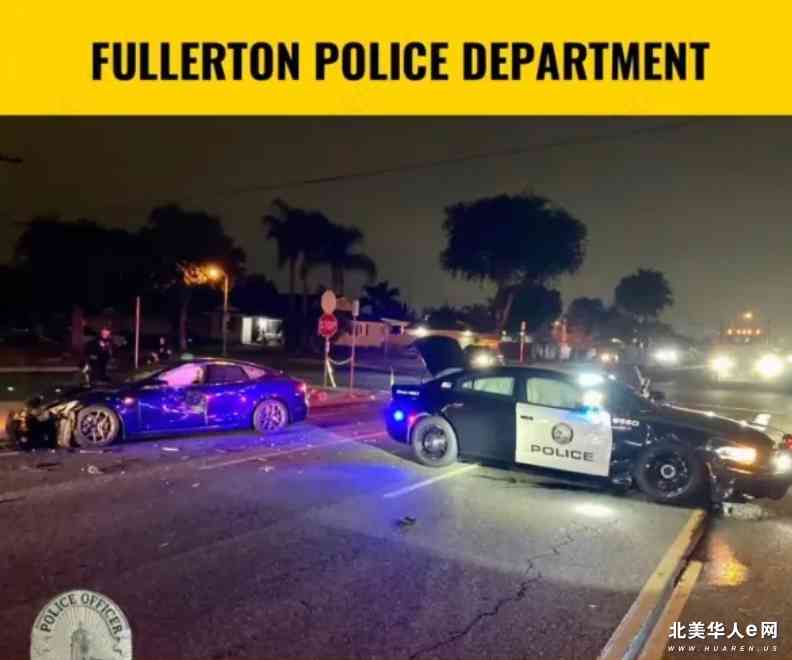

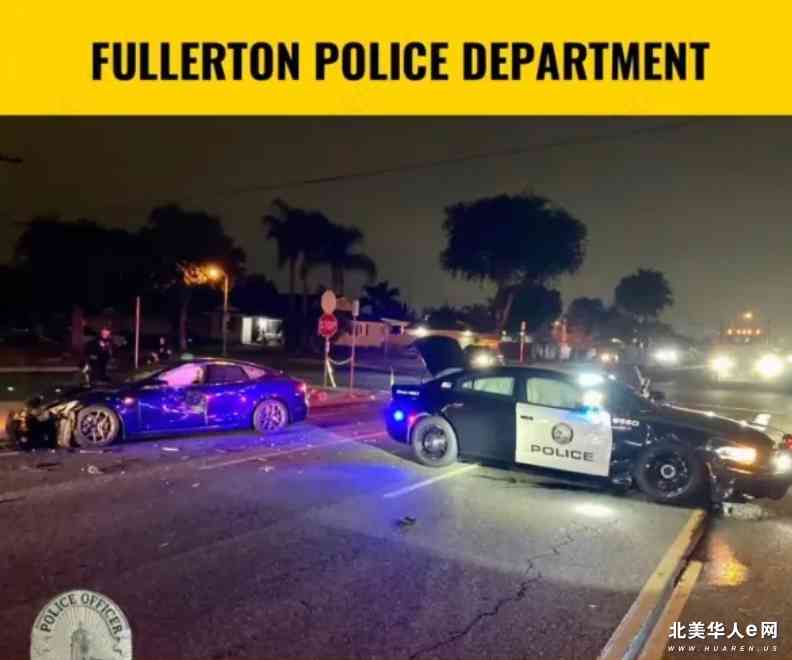

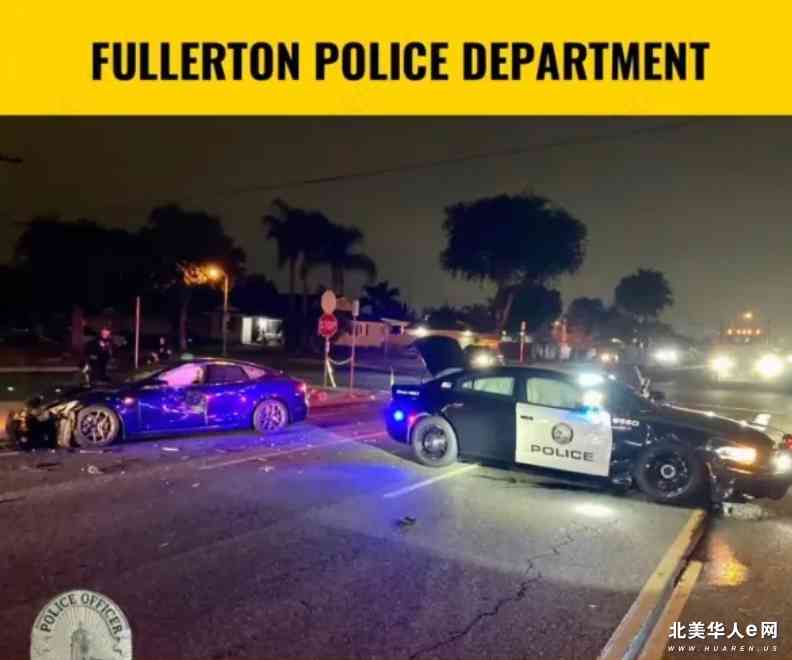

周四凌晨,一辆处于自动驾驶模式的特斯拉在橙县撞上了一辆正在处理一起致命交通事故的警车。事发时驾驶男子正在使用手机,汽车冲向警车时,惊险闪过正在指挥交通的另一名警察,警察本人也下意识跳开,才避免一场灾难。

用着手机!活该出事。

华! 发表于 2024-06-17 09:09

tastycakes 发表于 2024-06-17 10:05

开车用手机,跟特斯拉有什么关系。。。

ss4me 发表于 2024-06-17 10:13

特斯拉FSD不是全自动驾驶吗?既然是全自动驾驶,车子自己在开的时候乘客玩个手机应该是可以的吧

一生所爱 发表于 2024-06-17 10:04

自动驾驶就是这个问题 哪怕是万分之一的事故也会上新闻 反而人驾车撞人就压根上不了新闻 所以自动驾驶很难实现 因为人类会双标 自己驾驶车撞车就是普通accident

一生所爱 发表于 2024-06-17 10:04

自动驾驶就是这个问题 哪怕是万分之一的事故也会上新闻 反而人驾车撞人就压根上不了新闻 所以自动驾驶很难实现 因为人类会双标 自己驾驶车撞车就是普通accident

aiyamayayongle 发表于 2024-06-17 10:12

回复 6楼 一生所爱 的帖子

这个还真不是啥双标,是追责的事。自动驾驶出了事,甚至死人了,谁负责?马翼龙吗?

aiyamayayongle 发表于 2024-06-17 10:12

回复 6楼 一生所爱 的帖子

这个还真不是啥双标,是追责的事。自动驾驶出了事,甚至死人了,谁负责?马翼龙吗?

睿 发表于 2024-06-17 09:29

都多少年了,特斯拉连看到前面有阻碍物刹车都不会,还是老样子。

据说特斯拉为了省钱把雷达都拆除了,完全靠摄像头。所以距离判断完全靠摄像头的,在低光的情况下,譬如说晚上,错误率会增加。其实低光情况下,人眼也可能会出错,但是架不住人类是双标的。人可以出错,但是自动驾驶是不能出错的,否则就是大新闻。其实这个双标我觉得算合理要求,就算算数学题,对计算器的要求是0错误。同理,对自动驾驶的要求更高正常。

Leavesday 发表于 2024-06-17 10:54

省钱只是一个方面,最开始可能有这个因素,但是不是决定因素。再说了,激光雷达成本现在已经降了下来。Tesla在2022时给车安装了激光雷达,后来HW4时正式彻底取消。

主要原因我觉得是:Tesla选择的自动驾驶方向就是纯视觉方案,虽然业界大多数不是,也认为不对。但是一龙从最开始就坚持了这个方向,凡是不支持的工程师或是管理人员都被他开掉了。后来有很短一阵,Telsa顶不住,给车加了激光雷达,可是实际体验并没有提高多少,所以Tesla/一龙更加坚定了纯视觉路线,HW4就直接取消了激光雷达。

华为智驾也刚刚转向了这个纯视觉方向。

cr2069 发表于 2024-06-17 11:46

digialalpha 发表于 2024-06-17 12:01

华为智驾里不用激光雷达的属于低配版,说白了还是看不上纯视觉。

一生所爱 发表于 2024-06-17 10:04

自动驾驶就是这个问题 哪怕是万分之一的事故也会上新闻 反而人驾车撞人就压根上不了新闻 所以自动驾驶很难实现 因为人类会双标 自己驾驶车撞车就是普通accident

雁过 发表于 2024-06-17 10:10

用自动驾驶还不能分心看手机?

cr2069 发表于 2024-06-17 10:50

看来很多人对FSD或者智驾有误解。其实特斯拉也要对这个误解负责,因为FSD这个名字就非常误导。智驾是分等级的,要到Level4以上才算真正的自动驾驶,目前除了Waymo,Cruise在特定区域,特定条件下达到了这个要求,其它的都没有,都只能叫辅助驾驶。尤其Tesla这种大众化的产品。它最多只能算Level 2,是需要驾驶员一直集中精力,随时准备接管的。

如果用过就知道,1. Telsa智驾是必须手不能一直离开方向盘的,眼睛必须注意路况,2. 明确说了,只是辅助,不是替代驾驶,驾驶员不能分心。驾驶员必须随时准备接管驾驶。 3. 驾驶员不集中精力驾驶或者忽略,出事责任方在驾驶员,不是Telsa。另外Tesla随时实时监控驾驶员状态,如果分心会提醒,如果驾驶员忽略警告数次,就会被取消FSD驾驶权一个星期。

从另一个角度来说,FSD目前已经有超过上亿的里程数了,而出现的事故其实非常少,比例极小。虽然我不苟同一龙吹嘘的多少FSD帮助避免的事故,但是出事率确实很低。这一个个案很不幸,但是不能说明FSD就很差。个人体会,Tesla的FSD不完美,离真正全自动驾驶还差很远,但是在同行产品中确实现在是领先的,做的最好的那个。

中国的类似产品,应该还在起步阶段,以后完全可能追上来。这次回去争取试驾检验一下,看看体验如何。

cr2069 发表于 2024-06-17 12:03

哈哈,算是吧,它刚刚才转入这个方向,不敢随便给啥车上都用的。

一生所爱 发表于 2024-06-17 10:04

自动驾驶就是这个问题 哪怕是万分之一的事故也会上新闻 反而人驾车撞人就压根上不了新闻 所以自动驾驶很难实现 因为人类会双标 自己驾驶车撞车就是普通accident

一生所爱 发表于 2024-06-17 10:04

自动驾驶就是这个问题 哪怕是万分之一的事故也会上新闻 反而人驾车撞人就压根上不了新闻 所以自动驾驶很难实现 因为人类会双标 自己驾驶车撞车就是普通accident

bv骑士团 发表于 2024-06-17 10:33

特斯拉向加州法院承认了自己不是L5,只是L2。法律上是车主的责任。不过车主可以告Tesla false ad。 In a letter to the California DMV, Tesla admits that FSD is not full self-driving. The correspondence between Tesla and the California DMV notes that FSD and Autopilot are both SAE Level 2automation

另外还有一个车企claim他们的车自驾出问题的话,车企完全负责任,可惜没人care。大家都更喜欢充满噱头的Tesla

shanggj 发表于 2024-06-17 10:29

现在应该有统计 自动驾驶 和 人类驾驶 的 车祸比了。

gokgs 发表于 2024-06-17 10:42

特斯拉没有 LIDAR, 致命 bug.

光靠视觉,肯定各种漏洞。 好天, 路况好的时候就没问题。 好天, 桥底下一个大阴影,估计也是各种调整避免识别成路障。 也说不定警车识别成了阴影。

playForever 发表于 2024-06-17 15:05

自动驾驶不可能处理好各种各样 unexpected cases. 如果用自动驾驶出了大车祸,那肯定是相应的做自动驾驶 软件的公司得赔,那得赔死了。 所以说 Tesla 的 RobotoTaxi 就是一个噱头。 5年内在美国法规不可能批准全面实用。

cr2069 发表于 2024-06-17 10:50

看来很多人对FSD或者智驾有误解。其实特斯拉也要对这个误解负责,因为FSD这个名字就非常误导。智驾是分等级的,要到Level4以上才算真正的自动驾驶,目前除了Waymo,Cruise在特定区域,特定条件下达到了这个要求,其它的都没有,都只能叫辅助驾驶。尤其Tesla这种大众化的产品。它最多只能算Level 2,是需要驾驶员一直集中精力,随时准备接管的。

如果用过就知道,1. Telsa智驾是必须手不能一直离开方向盘的,眼睛必须注意路况,2. 明确说了,只是辅助,不是替代驾驶,驾驶员不能分心。驾驶员必须随时准备接管驾驶。 3. 驾驶员不集中精力驾驶或者忽略,出事责任方在驾驶员,不是Telsa。另外Tesla随时实时监控驾驶员状态,如果分心会提醒,如果驾驶员忽略警告数次,就会被取消FSD驾驶权一个星期。

从另一个角度来说,FSD目前已经有超过上亿的里程数了,而出现的事故其实非常少,比例极小。虽然我不苟同一龙吹嘘的多少FSD帮助避免的事故,但是出事率确实很低。这一个个案很不幸,但是不能说明FSD就很差。个人体会,Tesla的FSD不完美,离真正全自动驾驶还差很远,但是在同行产品中确实现在是领先的,做的最好的那个。

中国的类似产品,应该还在起步阶段,以后完全可能追上来。这次回去争取试驾检验一下,看看体验如何。

cr2069 发表于 2024-06-17 11:46

省钱只是一个方面,最开始可能有这个因素,但是不是决定因素。再说了,激光雷达成本现在已经降了下来。Tesla在2022时给车安装了激光雷达,后来HW4时正式彻底取消。

主要原因我觉得是:Tesla选择的自动驾驶方向就是纯视觉方案,虽然业界大多数不是,也认为不对。但是一龙从最开始就坚持了这个方向,凡是不支持的工程师或是管理人员都被他开掉了。后来有很短一阵,Telsa顶不住,给车加了激光雷达,可是实际体验并没有提高多少,所以Tesla/一龙更加坚定了纯视觉路线,HW4就直接取消了激光雷达。

华为智驾也刚刚转向了这个纯视觉方向。

alama 发表于 2024-06-17 15:48

先说tsla的是最好的,又说回去体验中国的,说明你没体验过其他的自动驾驶,结论就下了,有点早吧

gokgs 发表于 2024-06-17 15:13

慢慢来, 技术总是在进步, 可能没那么快。 单纯防撞应该还是很容易的, Lidar 就行。 Lidar 识别障碍物, 然后制动, 应该不难做。 不过, 大部分车还是没有 lidar 的。

Blackladybug 发表于 2024-06-17 09:26

自动驾驶这idea就是脑子抽筋了,要么把司机不当人要么把别的人不当人。人命不值钱?用生命的代价偷懒那么一会

yoyo2007 发表于 2024-06-17 16:34

这个也挺难的,ABS就是发现刹车过快会导致车翻滚和车内乘员死伤慢慢发明和改进的。 前面一头小鹿窜出来,100英里的速度直接踩死刹车可能车侧翻人保不住,还不如直接撞过去,车估计也报废了,大概率人还可以;自动防撞也是有速度上限的吧。

cr2069 发表于 2024-06-17 11:46

省钱只是一个方面,最开始可能有这个因素,但是不是决定因素。再说了,激光雷达成本现在已经降了下来。Tesla在2022时给车安装了激光雷达,后来HW4时正式彻底取消。

主要原因我觉得是:Tesla选择的自动驾驶方向就是纯视觉方案,虽然业界大多数不是,也认为不对。但是一龙从最开始就坚持了这个方向,凡是不支持的工程师或是管理人员都被他开掉了。后来有很短一阵,Telsa顶不住,给车加了激光雷达,可是实际体验并没有提高多少,所以Tesla/一龙更加坚定了纯视觉路线,HW4就直接取消了激光雷达。

华为智驾也刚刚转向了这个纯视觉方向。

cr2069 发表于 2024-06-17 15:56

我说的是北美这边的各种辅助驾驶。中国的我确实没有体验过,我是不相信那些视频的,要自己体验才又比较。

一生所爱 发表于 2024-06-17 10:04

自动驾驶就是这个问题 哪怕是万分之一的事故也会上新闻 反而人驾车撞人就压根上不了新闻 所以自动驾驶很难实现 因为人类会双标 自己驾驶车撞车就是普通accident

前段时间nyt上有篇文章讨论了作者体验国内的自动驾驶,结论是就那样吧。自动驾驶在国内是被政府扶持的新兴产业,出了事只要政府出面摆平就没关系。不像北美这边,舆论对安全性监督的很严,出了大的事故会让一个公司倒闭。Uber当时就是因为这个停止了自动驾驶研发

Ryerr 发表于 2024-06-17 17:55

睿 发表于 2024-06-17 09:29

都多少年了,特斯拉连看到前面有阻碍物刹车都不会,还是老样子。

cr2069 发表于 2024-06-17 12:03

哈哈,算是吧,它刚刚才转入这个方向,不敢随便给啥车上都用的。

Kirin9000s 发表于 2024-06-17 14:31

属实 雷达才是自动驾驶唯一可靠的设备 马斯克认为开车用人眼就行 这是认知错误 正因为人眼经常出现视觉误差才会有很多交通事故 更何况现在的ai还远远达不到人眼的准确度

gokgs 发表于 2024-06-17 21:57

要是跟你说的一样, 特斯拉早就被告死了。 特斯拉的 FSD 用户条款估计把自己摘的干干净净。 特斯拉自动驾驶弄死司机的事故好几起了吧? 光我知道的至少两起。 你根本没法告。

Uber CEO 主要是考虑公司盈利, 跟责任没有半毛关系。

gokgs 发表于 2024-06-17 21:57

要是跟你说的一样, 特斯拉早就被告死了。 特斯拉的 FSD 用户条款估计把自己摘的干干净净。 特斯拉自动驾驶弄死司机的事故好几起了吧? 光我知道的至少两起。 你根本没法告。

Uber CEO 主要是考虑公司盈利, 跟责任没有半毛关系。

Ryerr 发表于 2024-06-17 22:40

我前面回复了,再说一遍,Tesla那个fsd不是自动驾驶,这次事故责任在于那个司机。他们的条款里确实也是撇干净了责任。但elon大嘴巴误导消费者,让人误以为这是自动驾驶,行内人对此深恶痛绝。其实也有州开始介入这个,比如加州dmv就要告Tesla

alama 发表于 2024-06-17 15:48

先说tsla的是最好的,又说回去体验中国的,说明你没体验过其他的自动驾驶,结论就下了,有点早吧

Uber的2018事故你没follow吧?当时由于那次车祸,这个自动驾驶部门被要求停业整顿大半年,裁人,后来赔偿,这还好说,关键是失去了公众和监管机构的信心,也让公司高层意识到自动驾驶要注重安全,不能一蹴而就,这才为后来卖掉埋下伏笔

Ryerr 发表于 2024-06-17 22:53

ss4me 发表于 2024-06-17 10:13

特斯拉FSD不是全自动驾驶吗?既然是全自动驾驶,车子自己在开的时候乘客玩个手机应该是可以的吧

gokgs 发表于 2024-06-18 00:36

你读一下 https://www.npr.org/2020/12/08/944337751/uber-sells-its-autonomous-vehicle-research-division

你根本不懂 uber。 哈哈。