【新智元导读】PaLM2模型训练数据是上一代的5倍,达到3.6万亿。基于PaLM2的Bard对比ChatGPT有8项优势。

决定大模型能力的关键因素,到底是模型的参数,还是训练文本的大小?谷歌发布的PalM2,似乎选择了后者作为提升的主要路径。据悉,谷歌用于训练的PaLM2的文本数量几乎是训练其前身模型的5倍。而且上周宣布PaLM 2时,谷歌明确表示,该模型比早期的PaLM更小。谷歌内部文件显示,PaLM经过了5400亿的参数训练,而新推出的PaLM2,训练参数接近腰斩,只有3400亿个。

但是在另一个模型训练的关键数据——训练语料大小上,谷歌开始疯狂堆料,把PaLM的7800亿的训练token量直接推到了3.6万亿!而且除了Token数量的激增,PaLM2在数据质量上也有很大的提升。

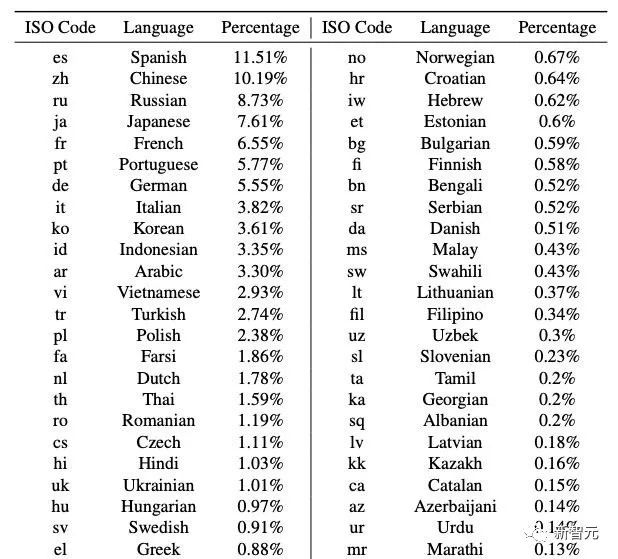

所以相比PaLM,第二代在英语语料数据量没有显著增长的情况下,英语性能明显提高,部分原因是因为英语数据的质量提升了。OpenAI没有公开GPT-4的训练参数数量,但是谷歌没有藏着掖着,主动公开了PaLM2训练参数。而且在谷歌I/O大会上,还同时发布了4个参数更少的模型。其中最小的一款模型 Gecko(壁虎),甚至可以在智能手机上运行。这一举动侧面反应了谷歌未来的野心,希望在更多的平台上部署自己的大模型。在这个大背景之下,从长远的角度来看,谷歌几乎不可能选择堆训练参数量来提升模型性能,增加训练语料的数量和质量几乎成了必然的选择。在I/O大会上宣布PaLM 2时,谷歌证实:该模型经过100种语言的训练,可以执行广泛的任务。它已经被用来为25个功能和产品提供支持,包括谷歌的实验性聊天机器人Bard。PaLM 2有四种尺寸,从小到大依次是:Gecko(壁虎)、Otter(水獭)、Bison(野牛)和Unicorn(独角兽)。基于现在公开披露的数据,PaLM 2比现有的任何模型都更强大。Meta的LLaMA在今年二月推出,它在1.4万亿个token上进行了训练。而上一次OpenAI分享训练规模,还是在推出GPT-3时,当时OpenAI说,它接受了3000亿个token的训练。另外,谷歌两年前曾提出LaMDA模型,当时它接受了1.5万亿个token的训练。AI军备竞赛升温,公众要求更高透明度

对于大模型训练数据的细节,大厂们都很默契地选择了「Close」。发布GPT-4时,OpenAI没有公布架构(包括模型大小)、硬件、训练计算、数据集构建、训练方法等细节,理由是「像GPT-4这样的大规模模型的竞争格局和安全影响」。被OpenAI逼到墙角的谷歌,也一直渴望展示自己AI技术的力量,包括如何将其嵌入到搜索、电子邮件、文字处理和电子表格中,但是此前,谷歌一直不愿意公布训练数据的大小或其他细节。无论是谷歌还是OpenAI,都在争抢着希望使用聊天机器人而不是传统搜索引擎的用户。但随着AI军备竞赛的升温,研究社区正在要求更高的透明度。而现在,随着AI应用迅速成为主流,围绕底层技术的争议也愈发激烈。随着新的人工智能应用迅速成为主流,围绕底层技术的争议也越来越激烈。今年2月,谷歌研究高级科学家El Mahdi因公司缺乏透明度,选择辞职。周二,OpenAI首席执行官Sam Altman在参议院司法小组委员会关于隐私和技术的听证会上作证,同意立法者的观点——需要监管AI的新系统。「对于一项非常新的技术,我们需要一个新的框架,」Altman说。「当然,像我们这样的公司,对于在全球推出的工具负有很大责任。」

相对于ChatGPT,Bard的一个显著优势就是——可以访问互联网。问问今天(5月17日)的体坛大事,Bard快速总结出来了。而ChatGPT无法直接访问互联网,只能通过其付费版本Plus上的插件访问网络。在生成图像上,Bard也超越了ChatGPT的付费和非付费版本。谷歌宣布将通过集成Adobe Firefly,提供AI图像生成功能。这个功能增强了对话的视觉效果,让用户获得了上下文更丰富的信息。在语音输入方面,Bard也优于ChatGPT,用户只要通过语音,就可以和模型交互了。这样在多任务处理和打字不方便时,用户就多了一种快速获取响应的边界方式。小编把今日体坛新闻的问题读了一遍,Bard就自动显示了。唯一要注意的是,英文发音要足够标准。🤣在编码能力上,Bard也超越了ChatGPT,它能够协助20多种编程语言,包括 C++、Python、Java、TypeScript、JavaScript等。它可以辅助开发者进行代码生成、解释和调试。相比之下,虽然ChatGPT也具有编码功能,但它在处理额外任务时存在不足,相比之下OpenAI的Codex可能更适合执行这些任务。让Bard用python生成一个斐波那契数列,并打出前10个数字。Gmail拥有超过20亿用户,是全球最大的电子邮件服务商。如果在邮件中能用Bard,无疑为电子邮件交互开辟了新的可能性。但是,微软也正把ChatGPT添加到Microsoft 365 中,并将嵌入到 Word、Excel、PowerPoint以及Gmail的竞争者中。另外,Bard还可以将结果立即导出到Gmail和Docs。用户可以将生成的内容直接导出到这些平台,轻松与他人分享。这个功能大大简化了共享信息的过程,使撰写电子邮件变得非常轻松。另一方面,OpenAI在设置中有一个类似的导出选项。用户可以导出帐户详细信息和对话,以可下载文件的形式发送到电子邮箱中。用户只需点击图片或使用Google Lens扫描图像,就可以向Bard寻求帮助了。比如,用户可以查找与某张图片类似的度假胜地,还可以询问其这个地点的历史意义。同样,GPT-4 也是一个多模态大模型,可以接受图像和文本输入,不过截至本文发布之日,在付费版本中也没有引入这个功能。因为Bard可以联网,因而它可以通过简单地共享链接来总结某个网页。相比之下,ChatGPT不能联网,用户只能手动复制和粘贴想要总结的内容。在测试过程中,当给出明确的有毒提示时,Bard在超过30%的时间内,会产生有毒反应。此外,在英语、德语和葡萄牙语等语言中,PaLM 2总体上会表现出更明显的毒性行为。总的来说,由于不同的架构和测试方法,直接比较这PaLM2和GPT-4有一定的挑战性。在推理任务中,PaLM 2的表现与GPT-4类似,甚至更好。不过,在编码任务中,PaLM 2需要多次尝试,以及额外的编码token,才能获得良好的性能。参考资料:

https://www.cnbc.com/2023/05/16/googles-palm-2-uses-nearly-five-times-more-text-data-than-predecessor.html

https://analyticsindiamag.com/8-things-that-bard-can-do-but-chatgpt-cant/