关于「AI灭绝论」引发的一系列争论,各路大佬们又吵起来了。这次加入争吵的是著名人工智能学者、斯坦福大学计算机科学系教授吴恩达。在此之前,深度学习三巨头 Geoffrey Hinton、Yoshua Bengio、Yann LeCun 的辩论已经开始。Hinton 和 Bengio 的观点基本一致,他们认为需要加强对 AI 技术的监管,例如,就在前几日, Hinton 和 Bengio 等再发联名信《在快速发展的时代管理人工智能风险》,呼吁在开发 AI 系统之前,研究者应该采取紧急治理措施,将安全和道德实践纳入重点,呼吁各国政府应该采取行动,管理 AI 带来的风险。然而,LeCun 的观点和他们并不相同,他对 AI 发展持有非常乐观的态度,认为 AI 的发展远未构成对人类的威胁。就在刚刚过去的一天,LeCun 在 X 上公开点名 Hinton 和 Bengio 等人,LeCun 认为「如果一些人(Hinton 和 Bengio 等人)的恐惧宣传活动取得成功,将不可避免地造成灾难性的结果:少数公司将控制 AI。绝大多数学术同行都非常支持开放式 AI 研发。很少有人相信你们所鼓吹的末日场景。你、Yoshua、Geoff 是唯一的例外。」在 LeCun 看来,AI 会构成对人类威胁这种言论必将造成一些垄断发生,结果是只有少数公司控制 AI 的研发,进而控制人们的数字产品依赖。LeCun 表示,这些问题曾让他彻夜难眠。图源:https://twitter.com/ylecun/status/1718670073391378694这边的辩论还没结束,吴恩达也加入进来了:「我对人工智能的未来最大的担忧是,过度夸大风险(例如人类灭绝)可能会促成人们制定压制开源和压制创新的规定。」吴恩达引用了一篇他最近发布的新文章,文中提到:「一些大型公司的游说者正试图说服规定制定者认为人工智能是非常危险的,而其中一些公司是不愿意与开源竞争的。」

引用文章链接:https://www.deeplearning.ai/the-batch/issue-220/

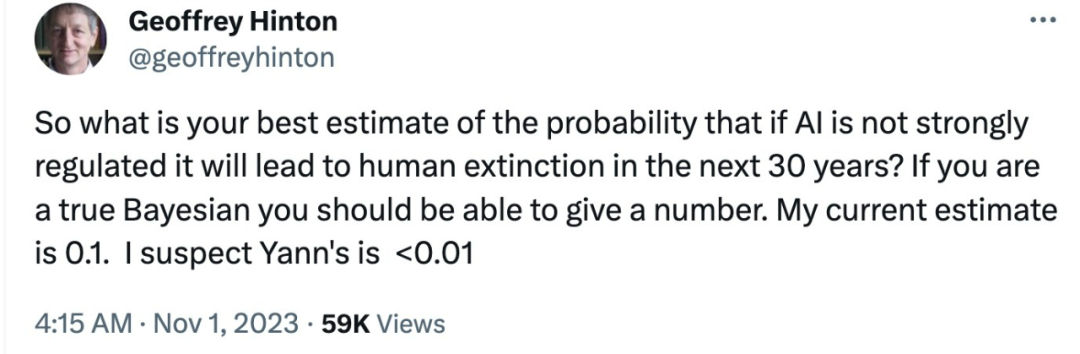

如果关于人工智能的规定会导致开源社区 AI 研究进展缓慢,或者小型初创公司遭遇创新瓶颈,那么一些大型科技公司可能会从中获利。Hinton 迅速在这条推特下面提出质疑:「如果人工智能不受到严格监管,它在未来 30 年内导致人类灭绝的概率是多少?如果您是真正的贝叶斯主义者,您应该能够给出一个数字。我目前估计是 0.1,我猜测 Yann LeCun 估计的数值 <0.01。」

LeCun 也很快给出回答:「我认为这个概率比人类灭绝的大多数其他潜在原因要少得多」,并反问 Hinton:「人工智能实际上可能会拯救人类免于灭绝,您估计这个概率是多少?」

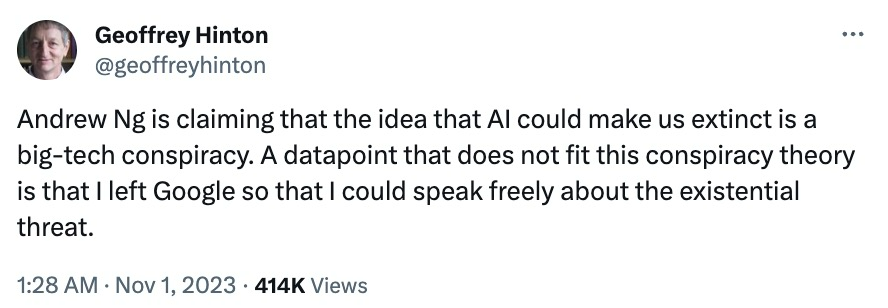

接着,Hinton 也发了一条推特:「我从谷歌离职就是对『阴谋论』观点最好的反驳。」

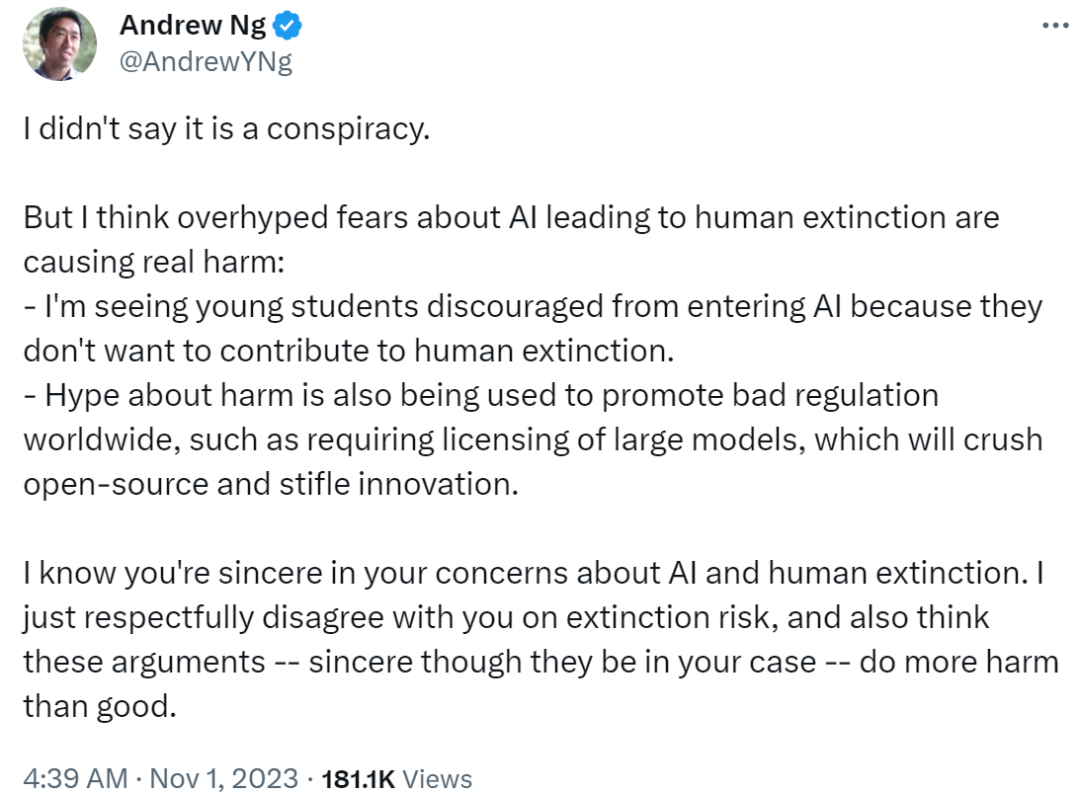

显然,Hinton 认为吴恩达把「AI 灭绝论」看成一场科技巨头的「阴谋」。吴恩达很快正面回击:「我并没有说这是一个阴谋。但我认为对人工智能导致人类灭绝的过度恐惧正在造成真正的伤害。」

吴恩达列举了目前「AI 灭绝论」造成的一些负面影响,包括:- 年轻的学生不愿进入人工智能领域,因为他们不想为人类灭绝做出贡献。

- 有关人工智能危害的炒作被用来促进全球范围内的不良监管,破坏开源,压制创新。

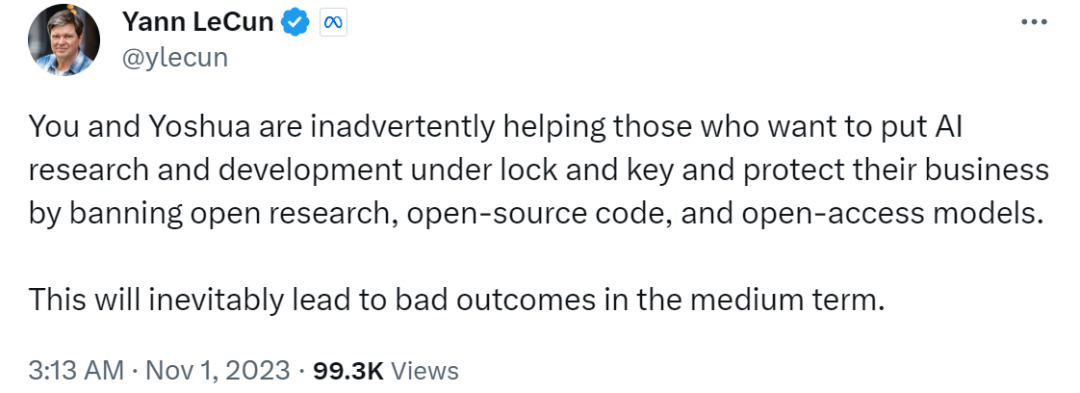

LeCun 也马上发表看法,称:「Hinton 和 Bengio 无意中帮助了那些想要通过禁止开放研究、开源代码和开放访问模型,来垄断人工智能研究、开发及业务的人。从长远来看,这将不可避免地导致不良结果。」

不管大佬们辩得如何,昨天拜登已经签署了首个生成式 AI 行政命令《关于安全、可靠、可信开发和使用人工智能的行政命令》(以下简称「命令」),该「命令」为人工智能的发展和使用设置了护栏,也是迄今为止美国最全面的 AI 监管原则。由于相当多机构参与了提供意见,「命令」读起来更像是各个不同(甚至对立)群体立场的拼凑。总之,到底该如何对待 AI,这是一个复杂的问题,需要综合考虑许多因素,随着时间的推移,这个问题会有答案的。

© THE END

转载请联系本公众号获得授权

投稿或寻求报道:[email protected]